Introduction

세계 인구가 증가함에 따라 식량작물의 생산량 증대가 요구되고 있다(Araus et al., 2014). 밭작물 생산량 증대를 위해서 작물의 성장, 영양상태, 관수 상태 등을 모니터링하여 적기 처방하는 것은 매우 중요하다. 형태적 표현형(phenotype)은 작물 생육의 중요한 지표이며 육종적 관점으로는 생물학적(biotic) 및 비생물학적(abiotic) 스트레스에 대한 내성 및 다수량 작물 등의 개발을 위한 필수 인자이다(Kim, 2020). 하지만 유전자와 관련된 작물의 표현형 특징에 대한 측정 및 기록은 시간이 많이 걸리고 측정하는 사람의 경험에 의해 주관적으로 평가되는 경우가 많다(Omari et al., 2020). 현재 대부분의 노지 작물 표현형 검정(phenotyping)은 숙련된 인력에 의해 수작업으로 진행되고 있으며, 현장 인력이 부족하여 한정된 정보만 획득하고 있으며 정보를 공유하거나 객관적인 정보를 시각화하기 어렵다는 단점도 있다.

객관적이며 정량적 측정 방식에 의한 작물 표현형 검정을 위해서 최근에 로봇, 무인기 등을 이용해 3D RGB 영상을 획득하는 기술이 적용되고 있다. 작물의 높이 예측 및 사진측정학 기반의 3D 이미징 기법을 이용한 분석을 통해 작목의 높이, 너비 및 임관(crown canopy)의 크기를 측정한 연구 사례가 있었다(Zermas et al., 2018; Jiang et al., 2019). 하지만 노지 환경에서 무인기를 이용하는 방식은 기상환경에 따라 제약이 심하다는 단점이 있다. RGB 영상은 간편한 측정 방식이지만 거리에 대한 정확한 측정이 어려워 작물의 정확한 표현형 검정에는 적합하지 않다.

3차원 입체정보 측정이 가능한 라이다(light detection and ranging, LiDAR) 기술은 레이저 파장을 목표 물체로 발사하여 반사광이 돌아오기까지 걸린 시간(time of flight, ToF)을 계산하여 특정 물체까지의 거리 및 물체의 크기를 정확하게 측정할 수 있다(Lefsky et al., 2002). 현재 정밀한 측정이 요구되는 자율주행, 우주탐사 등의 다양한 산업분야에서 활용되고 있으며, 3D 영상 센서의 핵심기술로 각광받고 있다. 라이다 스캐너에 의해 획득된 데이터는 위치정보 x, y, z 좌표를 가지는 점들로 저장되며 해당 데이터를 포인트 클라우드(point cloud)라고 하며(Jang et al., 2020), 포인트 클라우드는 3D 스캐닝 소프트웨어를 통해 스캔 된 환경이나 물체를 3D로 생성하여 분석 및 검사를 하는데 사용된다.

3D 라이다 포인트 클라우드를 이용한 측정은 다른 영상처리 기술과는 다르게 목표하는 대상의 정밀하고 정확한 거리 정보를 획득 가능하며 3D 모델링을 통한 샘플 데이터의 재구성 및 시각화가 가능하고, 해당 데이터의 크기, 거리 및 위치 정보를 파악하기에 용이하다. 또한 작목의 부피, 높이 등을 측정함에 있어서도 RGB 영상을 3D 재구성 및 포인트 클라우드 데이터를 생성하여 측정한 것에 비해 라이다 포인트 클라우드를 이용한 측정이 용이하다. 이러한 이유로 라이다 포인트 클라우드를 이용하여 옥수수(Qiu et al., 2019), 목화(Sun et al., 2018), 밀(Zhu et al., 2021) 등 다양한 농작물의 형태적 표현형을 검증 및 예측하기 위한 연구가 진행되었다. 또한 UAV, 비행기, 인공위성 등에 부착한 이동형 라이다 스캐너로부터 획득한 포인트 클라우드 데이터를 엽면적 지수 측정에 활용하는 등 다양한 연구가 활발히 진행중이다(Comba et al., 2020). 하지만 이동형 라이다 스캐너로부터 획득한 포인트 클라우드를 지상 고정형 라이다 데이터와 비교하였을 때 지상 고정형 라이다 스캐너로부터 획득한 포인트 클라우드 데이터가 나무의 크기 및 형태, 상대적 성장 스케일링, 대사기능 및 형태의 가소성을 측정하는 데 훨씬 적합하다고 보고되었다(Calders et al., 2020).

따라서, 본 연구에서는 3D 라이다 센서로부터 획득한 포인트 클라우드 데이터를 활용하여 국내 주요 밭작물 중 하나인 수수의 초고, 수관폭, 이삭의 길이와 직경을 정확하게 측정함으로써 고정형 3D 라이다 센서의 밭작물 형태적 표현형 검증 적용 가능성을 확인하고자 하였다.

Materials and Methods

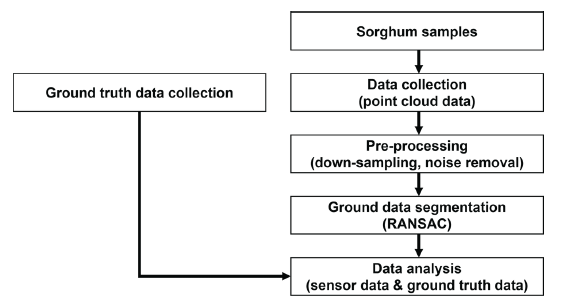

실험순서

본 연구는 실험 작물 양목, 포인트 클라우드 데이터 및 실측 데이터 획득, 데이터 전처리, 지면 추출, 그리고 포인트 클라우드 데이터로부터 획득한 예측값 및 실측값 사이의 비교 분석의 순서로 이루어졌다(Fig. 1).

실험재료

본 연구에서는 농촌진흥청 국립식량과학원(Miryang, Korea)에서 2013년 육종한 소담찰 품종의 수수 종자를 국립식량과학원으로부터 제공받아 실험시료로 사용하였다. 수수는 8월 18일 트레이 파종하여 25℃ 챔버에서 발아시켰다. 16시간 광 조사 및 8시간 암실 조성으로 2주간 기른 후, 충남대학교 교내의 유리온실로 이식하였다.

작물의 표현형 형질 가운데 초고(plant height)는 작물의 수명, 종자의 무게 및 성숙까지의 시간 등 작물의 수량 및 건강을 모니터링 하는데 주요한 결정 요인이며 작물을 모니터링하는데 중요한 형질 중 하나로 농업 분야에서 가장 기본적으로 측정하는 항목이다. 또한 수수의 주요한 형태적 특성으로는 초고, 이삭의 길이 및 너비, 종자의 무게, 수확량, 엽록소 함량 및 엽면적, 개화일, 총 8 개의 항목이 있다(Badigannavar et al., 2017). 본 연구에서 수수의 표현형 검정은 초고, 수관폭(crown diameter), 이삭의 길이 및 직경 총 4가지 항목에 대해 실시하였다.

수수의 초고를 위해 성장이 양호한 수수 25개를 선택하여 수수의 이삭이 나기 전인 7주차부터 10주차까지 총 4주동안 주 1회씩 총 100개의 샘플에 대한 데이터 획득을 진행하였으며, 나머지 3가지 항목에 대해서는 22개의 샘플에 대해 12주차부터 14주차까지 3주간 주 1회씩 총 66개의 샘플에 대한 데이터 획득을 진행하였다.

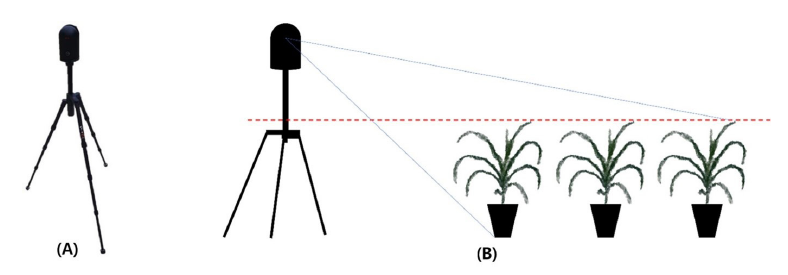

라이다 데이터 획득

본 연구에서 수수의 형태적 표현형 획득을 위해서 830 nm 단일 파장의 레이저를 사용하여 1초에 36만 개의 포인트 데이터를 획득할 수 있는 라이다 센서(BLK360, Leica Geosystems, Heerbrugg, Switzerland)를 이용하였다. 거리 측정 정확도는 10 m 거리에서 ± 4 mm이며 중앙에 위치한 거울과 센서 바닥면이 회전하는 방식을 사용하여 수평으로 360°, 수직으로 300°의 관측 시야(field of view, FOV)를 가진다. 수수의 라이다 포인트 클라우드 데이터 획득을 위해 Fig. 2와 같이 센서와 가장 바깥쪽에 위치한 샘플 사이의 거리를 약 1.5 m로 두고 각 샘플의 segmentation의 용이성을 위해 각 샘플이 맞닿지 않도록 위치시켰다. 또한 라이다 센서가 사용하는 레이저 파장의 특성상 물체를 통과하지 못해 가려진 물체에 대한 측정이 불가능하므로 샘플의 포인트 클라우드 데이터를 최대한 많이 획득하기 위해 각 샘플이 센서를 기준으로 최대한 일직선상에 위치하지 않도록 샘플을 위치시켰다. 또한 센서를 식물 샘플의 최대높이보다 높게 위치시킨 후 데이터를 획득하였다. 수수의 경우 샘플의 개수가 많아 두개의 그룹으로 나누어 데이터 획득을 실시하였으며, 수수 각 그룹당 10회의 다른 위치에서 데이터를 획득하였다. 라이다 센서는 광량에는 영향을 거의 받지 않지만 샘플의 위치가 달라지거나 바람 등에 의해 잎이 흔들리는 등의 변동에 취약하기 때문에 공기 유동이 거의 없고 사람의 왕래가 적은 온실 내부에서 데이터 획득이 진행되었다.

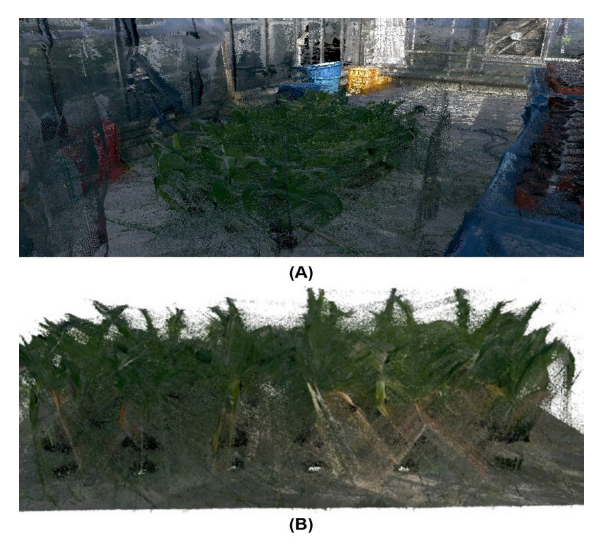

포인트 클라우드 데이터 전처리

센서로부터 획득된 데이터는 60 m 까지의 측정 거리를 가지는 센서 특성상 주변의 구조물 등 불필요한 데이터가 많으며 이로 인해 연산속도가 길어진다. 따라서, Cyclone Register360 (Ver. 2021.1.0, Leica Geosystems, Heerbrugg, Switzerland) 프로그램을 이용하여 센서의 데이터를 PC에 생성 및 ROI (region of interest) 설정을 하였다(Fig. 3).

이후 획득된 포인트 클라우드의 모든 처리과정은 Windows 환경에서 Python 3.8 및 python에서 3D 데이터를 다루기 위해 활용되는 강력한 오픈소스 라이브러리인 Open3D 0.13.0 및 CloudCompare (ver. 2.12 alpha) 소프트웨어를 활용하여 진행하였다.

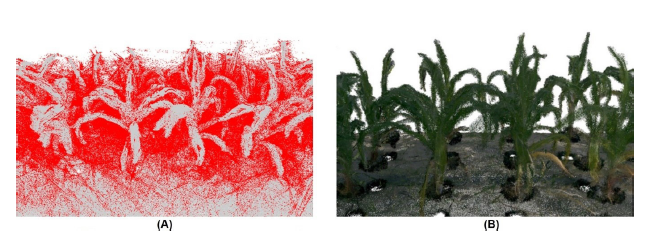

라이다 센서로부터 획득한 포인트 클라우드 데이터는 대상물의 물리적 및 화학적 특성, 장비의 감도, 환경 등의 요인으로부터 기인한 노이즈를 포함하고 있다(Ullrich et al., 2018)(Fig. 4). 따라서, 본 연구에서는 포인트 클라우드를 이용한 정밀한 측정에서 위치 및 크기에 관한 정보에 영향을 끼치는 노이즈를 제거하기 위해 SOR (statistical outlier removal) 필터를 사용하였다. SOR은 각 포인트에서 인접 포인트까지의 평균 거리를 계산한 후, 결과의 분포가 가우스 분포라고 가정하며, 각 포인트 사이의 평균 거리가 전역 거리 및 표준 편차 값보다 큰 값을 가지는 모든 포인트를 노이즈 또는 이상치로 간주하여 삭제하는 필터다. 입력되는 파라미터로는 목표 포인트에 인접한 이웃 포인트의 수(n)와 표준편차 비율(σ)이 있다(Rakotosaona et al., 2019). 본 실험에서는 인접한 이웃 포인트가 150개를 넘지 않는다면 작물이 아니라고 간주하여 n = 150, Open3D의 SOR 필터가 제공하는 기본 parameter 값으로 σ = 0.05로 선택하여 실행하였다.

또한 포인트 클라우드 원본 데이터의 경우 총 10회 획득한 데이터를 하나로 합친 데이터로 용량이 클 뿐 아니라 volume과 pixel의 합성어로 3D 공간의 기본 단위인 복셀(Voxel)에 수많은 포인트 데이터가 존재하게 된다. Voxel grid down-sampling (VGD)은 단위 공간 안에 존재하는 데이터들을 하나의 대표 값으로 표현하여 불필요하게 큰 데이터의 크기를 줄이는 역할을 한다(Josyula et al., 2019). VGD를 수행할 때 voxel의 크기를 크게 설정할 경우 대상체를 구성하는 포인트가 지나치게 간략하게 표현되어 표현형 형질에 유의미한 데이터의 손실이 발생할 수 있으며, voxel의 크기가 작을 경우데이터의 변화가 거의 없기 때문에 적절한 voxel 크기 설정이 요구된다. 4 mm의 voxel을 이용하여 VGD를 실행한 결과 데이터의 밀도가 2 mm voxel을 이용하여 VGD 한 데이터에 비해 밀도가 희박해지고, 12 mm voxel을 이용하여 VGD 한 것에 비해 형태적 특성에 유의미한 점을 유지하고 있음을 확인하였다. 따라서 본 연구에서 voxel의 크기 파라미터는 4 mm로 설정하여 VGD를 수행하였다(Fig. 5).

지면 추출

본 연구에서 샘플의 지면 데이터를 추출하기 위한 방법으로 random sample and consensus (RANSAC) 알고리즘을 사용하였다. RANSAC은 노이즈 또는 이상치가 많은 데이터 속에서 선, 원통, 평면 등의 특정한 모델에 일치하는 정상치(inlier)를 찾는 알고리즘이다(Li et al., 2017). 본 연구에서는 화분 속의 토양 및 온실의 지면 평면 데이터를 분리하기 위해 사용하였다. 평면을 추출하기 위한 임계값을 0.02, 평면을 구성하는 최소 포인트 개수를 50 및 가장 많은 포인트를 지면 데이터로 간주하였고, 지면 평면 추출을 위해 500 회 반복 실시하였다. 보통의 경우 추출된 평면이 정상치로 인식되나 본 연구에서는 지면에 대한 데이터를 제거하려는 목적으로 사용하므로 해당 평면을 이상치로 간주하여 삭제하였다.

데이터 분석

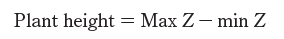

수수 샘플의 초고 정보 추출을 위해 각 작물을 구성하는 포인트 클라우드 데이터셋의 수직 높이 정보를 포함하는 z값의 최대값 및 최소값의 차이를 계산하였다. 센서로부터 획득한 데이터의 수평 기울기는 자동으로 보정되어 실제와 데이터 상의 작물의 위상정보가 동일하기 때문에 작물을 구성하는 포인트 클라우드 데이터의 최하단 z값에서부터 작물의 수직 최상단 z값의 차이가 식물의 초고를 나타낸다고 판단하였다(Wang et al., 2020). 초고는 식(1)을 통해 산출하였으며, 여기서 Max Z (maximum z value) 및 min Z (minimum z value)는 각각 최대 z값 및 최소 z값을 의미한다.

(1)

(1)

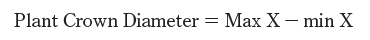

수수의 수관폭 정보 추출을 위해 각 작물의 포인트 클라우드 데이터셋의 수평 너비 정보를 포함하는 XY 평면 상의 최대 거리를 계산하였다. 먼저, 샘플의 수평 최대 길이가 X축 선상에 위치하도록 조정하였으며, 최대 x값과 최소 x값의 차이가 식물의 수관폭을 나타낸다고 판단하였다. 수관폭은 식(2)를 통해 산출하였으며, 여기서 Max X (maximum x value) 및 min X (minimum x value)는 각각 최대 x값 및 최소 x값을 의미한다.

(2)

(2)

수수 이삭의 높이 정보 추출을 위해 각 이삭에 해당하는 포인트 클라우드 데이터를 CloudCompare 및 Cyclone 3DR (ver. 2021.1.0, Leica Geosystems, Heerbrugg, Switzerland) 소프트웨어를 사용하여 수작업으로 segmentation을 진행하였고, 이삭의 길이는 작물의 초고와 동일하게 식(1)을 통해 산출하였다. 수수 이삭의 직경을 구하기 위해 영상의 타원 형태를 추출하는 Ellipse fitting을 사용하였다(Aiteanu et al., 2014). Ellipse fitting 함수는 OpenCV의 내장함수로 영상의 외곽선 좌표를 추출하여 해당 외곽선을 구성하는 타원형을 산출해낸다. 해당 타원의 장축을 수수 이삭의 직경으로 간주하였다.

라이다 포인트 클라우드를 이용한 표현형 검정 성능 평가

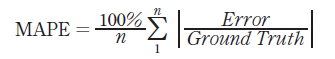

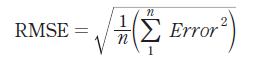

수수의 포인트 클라우드 데이터를 통한 형태적 특성 예측값의 정확성 검정을 위해 줄자와 버니어 캘리퍼스를 이용하여 실제값을 측정하였다. 센서 예측값과 실제로 측정한 값의 비교를 위해 mean absolute percentage error (MAPE) 및 root mean square error (RMSE)를 계산하였다. MAPE 및 RMSE는 각각 식(3)과 식(4)를 통하여 산출하였다.

(3)

(3)

(4)

(4)

Results and Discussion

노이즈 제거

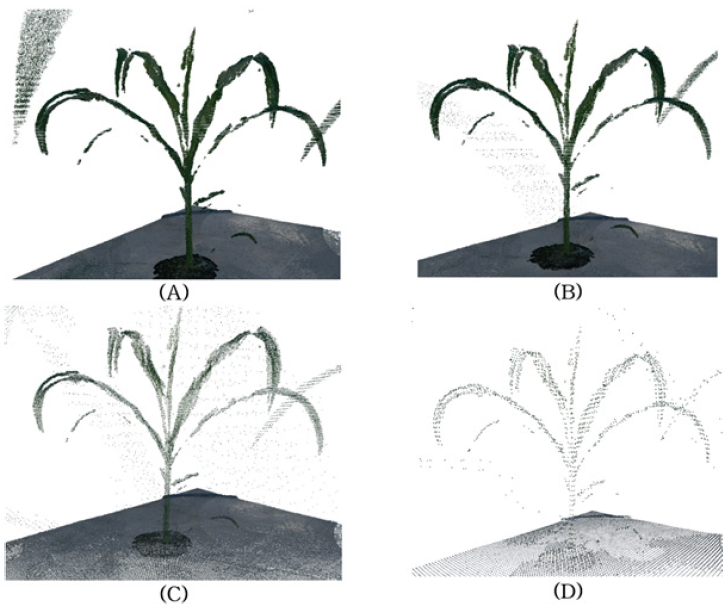

Fig. 4은 SOR 필터를 통한 수수의 포인트 클라우드 데이터 노이즈 제거 전〮〮〮 〮 후〮〮를 비교한 것이다. Fig. 4A 에서 확인할 수 있듯이, 붉은 색으로 표시된 영역이 SOR 필터에서 노이즈로 구분한 것으로, 해당 점들을 삭제한 결과는 Fig. 4B와 같다. SOR 필터를 통한 라이다 포인트 클라우드 데이터의 노이즈 제거 적절하게 수행됨을 확인하였다.

다운 샘플링

Fig. 5는 VGD 함수를 통한 수수의 포인트 클라우드 데이터의 다운 샘플링 전〮〮〮 〮 후를 비교한 것이다. Fig. 5C는 Fig. 5B 및 Fig. 5D 에 비해서 형태적 특성에 유의미한 점들의 유실이 발생하지 않았고, 포인트의 개수가 줄어듦을 확인할 수 있었다. VGD 적용 전〮〮〮 〮 후의 시각화 속도 비교를 통해 연산속도 향상을 확인해본 결과, VGD 전에 비해 VGD 후 연산 속도가 약 25%에서 약 60%까지 감소하였음을 확인할 수 있었다.

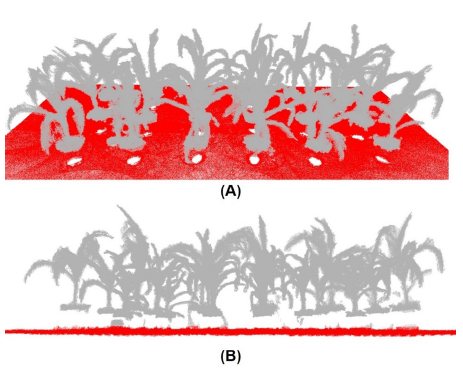

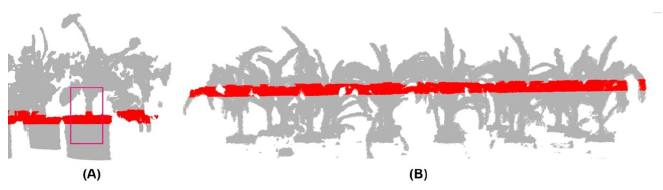

지면 추출

앞서 언급한 바와 같이, RANSAC 알고리즘을 이용하여 수수의 포인트 클라우드 데이터에서 지면에 해당하는 평면을 분할하였다. Fig. 6에서 확인 할 수 있듯이 완전한 평면을 이루는 건축물의 바닥의 검출에 높은 성능을 가짐을 확인할 수 있었다. 하지만, 본 실험과 같이 화분 속 토양의 높이가 각각 다르거나, 노지 밭 환경과 같이 고랑이 있거나 노면이 고르지 못한 경우에는 RANSAC 알고리즘을 통해서 지면의 데이터를 추출하는 방법은 활용도가 다소 떨어질 것으로 판단된다. Fig. 7과 같이 추출된 평면이 기울어진 경우에는 표현형 검정에 유의미한 샘플의 기관 중 일부가 이상치로 간주되어 삭제될 수 있고, 또한 가장 많은 포인트를 포함하는 평면을 추출하는 알고리즘의 특성상 Fig. 7B와 같이 토양이 아닌 식물의 중앙 부분을 관통하는 평면을 추출할 수 있으므로 digital surface model (DSM)과 digital terrain model (DTM)의 오차인 canopy height model (CHM)을 사용하는 방식 (Mielcarek et al., 2018) 등 각각의 샘플을 효과적으로 분할할 수 있는 방법을 고려해야 할 것으로 판단된다. 또한 향후 노지에서 행해질 실험에서는 기계를 이용한 파종이 끝난 이후의 토양의 데이터를 미리 측정함으로써 작물이 성장함에 따라 초고 값을 시기별로 획득 가능성이 있을 것으로 판단하였고, 해당 방식을 통해 초고 예측의 정확도를 높일 수 있을 것으로 기대된다.

라이다 포인트 클라우드를 이용한 표현형 검정 성능 평가

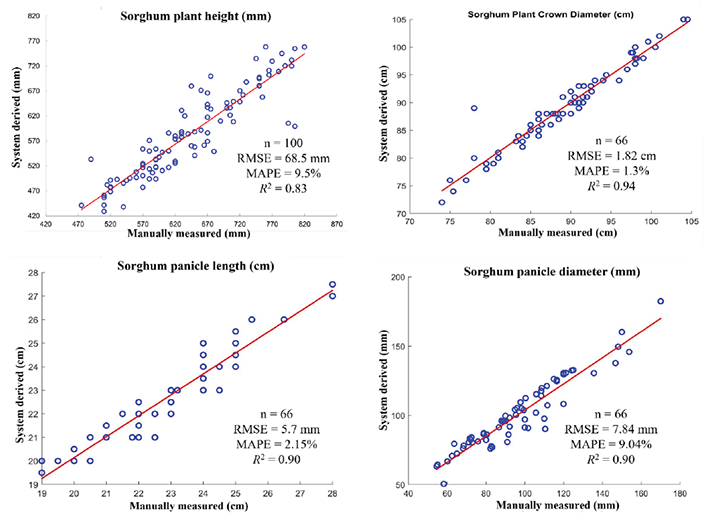

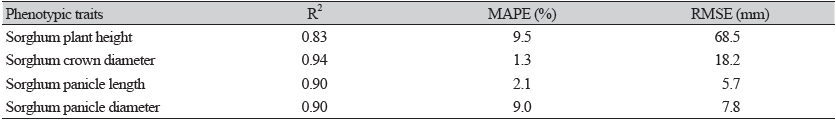

획득한 식물의 포인트 클라우드 데이터로부터 수수의 형태적 특성을 추출하고 직접 실측한 값과 비교하여 성능 검정을 실시하였다. Table 1과 Fig. 8에 실측값과 예측값의 측정 오차를 나타내었다. 수수의 데이터 획득 전체 기간에 대한 초고, 수관폭, 이삭 길이 및 직경을 측정한 데이터의 실측값과 예측값의 MAPE는 각각 9.5, 1.3, 2.2, 9.0%, RMSE는 각각 68.5, 18.2, 5.7, 7.8 mm로 실제 측정값에 비해 센서 예측값이 작게 나타났다. 수수의 초고를 예측한 RMSE가 60 mm 이상 차이나는 이유로 지면을 분리하는 과정에서 샘플의 초고를 측정하는데 유의미한 점들이 이상치로 간주되어 유실되었기 때문으로 판단된다(Fig. 7). 실제 농가 및 연구 현장에서 작물의 생육인자를 측정하는 경우 mm 단위까지 정밀하게 측정하여 모니터링에 반영하며, 작물의 모니터링을 위해서는 ± 10 mm 이하의 측정 오차가 요구된다. 수관폭의 경우 MAPE가 1.3%로 네 개의 측정 항목 중 가장 높은 예측 정확도를 나타냈지만 RMSE는 18.2 mm로 추가적인 성능 향상이 필요할 것으로 판단된다. 수수 이삭의 경우 작물의 세부 기관으로 ± 2 mm의 측정 오차를 목표로 하고 있기 때문에 본 실험에서의 이삭 크기 및 직경 예측의 RMSE는 각각 5.7, 7.8 mm로 추가적인 측정 성능 향상이 필요할 것으로 사료된다. 보다 정밀한 측정 및 표현형 검정에 유의한 점의 유실을 막기 위해 최적화된 parameter 설정 및 딥러닝 알고리즘을 이용하는 등의 새로운 분할 방법을 추가로 연구 및 사용해야 할 것으로 판단된다.

Conclusion

본 연구에서는 3D 라이다 포인트 클라우드를 이용하여 수수의 형태적 특징 자동 예측의 가능성을 확인하고자 하였다. 4주간 획득한 수수의 초고 데이터와 3주에 걸친 수수의 수관폭, 이삭 길이 및 직경 데이터에 대한 실제 측정값 및 센서 예측값을 비교 분석하였다. 3D 라이다 센서를 이용해 획득한 포인트 클라우드 데이터는 노이즈 제거 및 다운 샘플링을 통해 전처리하고 작물의 형태적 특성을 추출하기에 가장 최적화된 데이터를 획득하는 방법을 구명하였다. 수수의 형태적 특성 실측값 및 예측값 사이의 상관관계를 비교〮〮〮 〮 분석한 결과 수수의 경우 모든 R2 값이 모두 0.80 이상, MAPE의 경우 모두 10% 이내, RMSE는 5.7 mm에서 68.5 mm 로 3D 라이다 포인트 클라우드를 이용한 표현형 검정이 가능함을 확인할 수 있었다. 본 연구의 결과는 노지 작물 모니터링 및 표현형 검정을 위해 3D 라이다 시스템을 활용할 경우 실측에 투입되는 인력의 감소가 가능하며 또한 수작업 측정을 자동 측정으로 대체할 수 있어 노동력 및 측정 소요시간 감소로 인한 경제적인 효과를 기대할 수 있을 것으로 판단된다. 본 연구를 기반으로 초고, 이삭 크기뿐 아니라 엽수, 잎의 길이, 너비, 줄기의 직경 등 다른 주요 생육인자들에 대한 표현형 검정 기술개발도 가능할 수 있으리라 사료된다. 또한 해당 기술의 자동화를 위해서는 개별 작물을 자동으로 detection 할 수 있어야 하며, 딥러닝 알고리즘 등의 적용을 통해 개별 작물을 detection 한 이후, 본 연구에서 구명한 알고리즘을 통해 각 형태적 특성 검출의 자동화가 가능할 것이라고 기대된다.

Acknowledgements

본 연구는 농촌진흥청(Rural Development Administration) 공동연구사업(과제번호: PJ015689)의 지원을 받아 이루어진 것임.

Authors Information

Eun-Sung Park, https://orcid.org/0000-0001-6826-2865

Ajay Patel Kumar, Chungnam National University, Post-Doc

Muhammad Akbar Andi Arief, Chungnam National University, Ph. D. Student

Rahul Joshi, https://orcid.org/0000-0002-5834-2893

Hongseok Lee, Rural Development Administration, Agricultural Researcher

Byoung-Kwan Cho, https://orcid.org/0000-0002-8397-9853